Google Shopping et Fichier robots.txt : Synergie SEA / SEO gagnante

16 février 2023 – Even Hochart

Date de mise à jour : 31 mai 2024

Saviez-vous que les paramétrages SEO peuvent avoir un impact direct sur les campagnes Google Shopping ?

Nous savons déjà que les optimisations SEO peuvent avoir un impact positif sur le quality score des campagnes Google Ads Search, en enrichissant les contenus du site avec les mots-clés achetés en SEA par exemple, ce qui augmente les performances des campagnes.

Mais il existe également des spécificités à connaître afin de garantir une diffusion optimale des campagnes Shopping, essentielles pour tout client e-commerce.

C’est ce que nous avons pu découvrir à travers un cas client notamment : une marque de vente en ligne de prêt-à-porter, disposant d’un catalogue d’environ 20 000 produits.

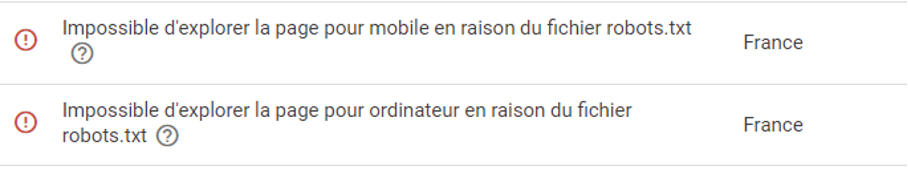

Google Merchant Center : erreur robots.txt

Un peu de contexte :

Cette marque effectue une migration de Magento 1 à Magento 2,

Le flux de produit envoyé dans le Merchant Center (plateforme Google permettant de faire le pont entre son site et les campagnes Google Shopping) est donc mis à jour, les urls ayant été modifiées pour répondre aux exigences de Magento 2,

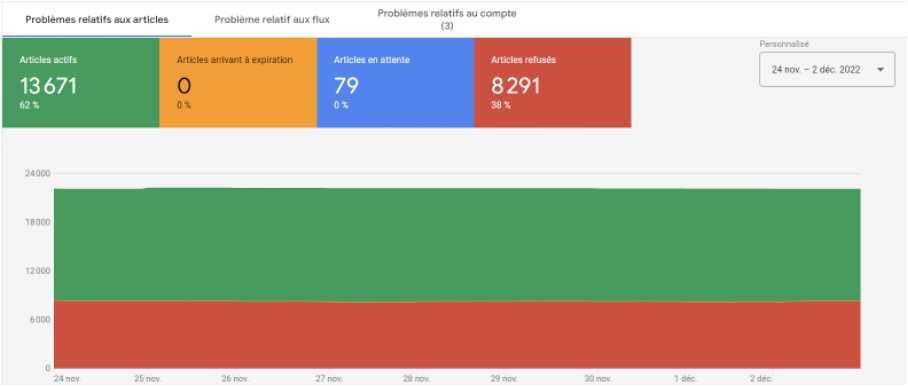

De nombreux produits présents dans ce nouveau flux sont refusés, car le fichier robots.txt présent sur le site bloque leurs urls,

Au final, environ 40% du catalogue est bloqué à la diffusion sur Shopping, avec un impact considérable sur le chiffre d’affaires,

Vous souhaitez évaluer la pertinence de Google Ads dans votre stratégie ?

Profitez de 30 minutes de consulting stratégique avec un consultant expert de l'agence Google Ads NOIISE !

Fichier robots.txt et URLs produits

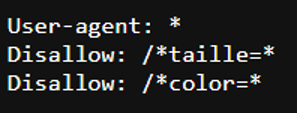

Il s’avère que les urls bloquées en question l’étaient à cause de paramètres d’urls présents dans celles-ci,

En effet, pour un produit, disons une robe, il existait plusieurs déclinaisons en fonction de la couleur et de la taille choisie. Chaque variation de taille et de couleur avait sa propre url, contenant le paramètre de taille et de coloris adéquat,

Exemple : robe = www.siteweb.com/robe ; robe bleu = www.siteweb.com/robe?color=01 ; robe bleu taille 40 = www.siteweb.com/robe?color=01&taille=40

Chaque variation était également considérée comme un produit à part entière dans le flux, possédant donc son propre ID produit.

Or, côté SEO, ces multiples urls avec paramètres n’ont aucune valeur pour le référencement naturel.

En grand nombre, si elles étaient indexées, elles détourneraient l’attention du bot Google des pages réellement stratégiques, ce qui serait un vrai casse-tête pour tout bon SEO de « cleaner » l’indexation et mettre en valeur les pages les plus intéressantes.

C’est pour cette raison que les urls avec ces paramètres ont été bloquées dans le fichier robots.txt à la migration, afin d’empêcher le crawl Google de les prendre en compte.

Les règles ayant été appliquée à tous les User-Agent (*) le Google Bot lié à Google Ads s’est également retrouvé bloqué, d’où l’erreur au niveau du Merchant Center.

Synergie SEO / SEA

Plusieurs options s’offrent à nous dans ce cas :

- Autoriser les paramètres d’url dans le fichier robots.txt : solution recommandée par Google Shopping, mais qui demande donc un travail SEO poussé pour gérer l’indexation et nuit aux performances à court et moyen terme

- Réécrire les urls dans le flux : permet de continuer à bloquer les urls avec paramètres dans le robots.txt, tout en les exploitant dans les campagnes Shopping, mais demande un travail de développement poussé

- Retirer les urls avec paramètres du flux Shopping : solution qui ne demande aucun effort de développement ni SEO, mais qui implique une moins-value énorme sur les performances Ads

Notons que l’autorisation de ces paramètres d’urls pour d’autres robots, comme l’Adsbot-Google ou le Mediapartners-Google, sensés régir l’indexation pour les outils Google payants, a été testée sans succès, le Google Bot SEO leadant par ses règles l’ensemble des autres robots.

Nous avons donc choisi la deuxième option dans ce cas, c’est-à-dire réécrire l’ensemble des urls avec paramètres sur le site et dans le flux.

Nous avons indiqué dans les urls, pour chaque coloris ou taille, un paramètre “codé” qui n’entre pas en conflit avec les blocages du robots.txt.

Le travail de développement nécessaire (et donc son coût) est important, mais il permet de consolider la stratégie SEO et Shopping / Ads sur le long terme.

Ainsi, le robots.txt peut continuer à indexer les pages prioritaires et les campagnes Shopping peuvent continuer à diffuser sur l’ensemble du catalogue, sans être bloquées.

Les performances Shopping sont depuis revenues à des niveaux pré-migration Magento 2.

On voit donc ici l’importance d’une synergie entre les actions SEO et SEA, symbolisée par la stratégie du fichier robots.txt,

Mais de nombreuses autres actions entre les deux métiers sont interconnectées et peuvent réellement améliorer vos performances digitales si elles sont harmonisées,

L’optimisation des contenus des landing pages mais aussi les choix de positionnements des mots-clés, pour ne citer qu’elles,

Il est donc dans votre intérêt de choisir une agence où les équipes SEO et SEA travaillent ensemble, pour la réussite de votre stratégie digitale,

N’hésitez donc pas à prendre contact avec nous pour une stratégie SEM personnalisée.

Vous souhaitez en savoir plus les

services de NOIISE en référencement payant ?

Aller plus loin avec d’autres articles